东京理工大学的研究人员现已开发出一种名为“Hiddenite”的新型加速器芯片,该芯片可以在计算稀疏“隐藏神经网络”时实现最先进的精度,并且计算负担较低。通过采用建议的片上模型构造,即权重生成和“超级掩码”扩展的组合,Hiddenite 芯片大大减少了外部存储器访问,从而提高了计算效率。

深度神经网络 (DNN) 是用于 AI(人工学习)的复杂机器学习架构,需要大量参数来学习预测输出。然而,DNN 可以被“修剪”,从而减少计算负担和模型大小。几年前,“彩票假说”席卷了机器学习世界。该假设指出,随机初始化的 DNN 包含在训练后达到与原始 DNN 相当的精度的子网络。网络越大,成功优化的“彩票”就越多。因此,这些彩票允许“修剪”的稀疏神经网络达到与更复杂、“密集”网络相当的精度,从而减少整体计算负担和功耗。

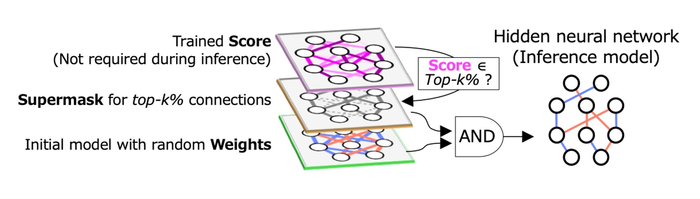

找到此类子网络的一种技术是隐藏神经网络 (HNN) 算法,该算法在初始化的随机权重和称为“超级掩码”的“二进制掩码”上使用 AND 逻辑(仅当所有输入都为高时输出才高) (图。1)。由 top-k% 最高分数定义的超级掩码分别表示未选择和选择的连接为 0 和 1。HNN 有助于从软件方面降低计算效率。然而,神经网络的计算也需要硬件组件的改进。

传统的 DNN 加速器提供高性能,但没有考虑外部内存访问带来的功耗。现在,由 Jaehoon Yu 和 Masato Motomura 教授领导的东京工业大学 (Tokyo Tech) 的研究人员开发了一种名为“Hiddenite”的新型加速器芯片,该芯片可以计算隐藏的神经网络,并大大降低了功耗。“减少外部存储器访问是降低功耗的关键。目前,实现高推理精度需要大型模型。但这增加了对加载模型参数的外部存储器访问。我们开发 Hiddenite 的主要动机是减少这种外部存储器访问,”Motomura 教授解释说。他们的研究将在即将到来的2022年国际固态电路会议 (ISSCC)是一个著名的国际会议,展示了集成电路成就的巅峰。

“Hiddenite”代表 Hidden Neural Network Inference Tensor Engine,是第一款 HNN 推理芯片。Hiddenite 架构(图 2)在减少外部存储器访问和实现高能效方面具有三重优势。首先是它提供了片上权重生成,用于通过使用随机数生成器重新生成权重。这消除了访问外部存储器和存储权重的需要。第二个好处是提供“片上超级掩膜扩展”,它减少了需要由加速器加载的超级掩膜数量。Hiddenite 芯片提供的第三项改进是高密度四维 (4D) 并行处理器,可在计算过程中最大限度地重复利用数据,从而提高效率。

“前两个因素使 Hiddenite 芯片有别于现有的 DNN 推理加速器,”Motomura 教授透露。“此外,我们还引入了一种新的隐藏神经网络训练方法,称为‘分数蒸馏’,其中传统的知识蒸馏权重被蒸馏到分数中,因为隐藏神经网络从不更新权重。使用分数蒸馏的准确性与二元模型相当,而大小只有二元模型的一半。”

标签:

免责声明:本文由用户上传,如有侵权请联系删除!